شبکه عصبی حافظه طولانی کوتاه مدت چیست؟

LSTM یک نوع شبکه عصبی است که با استفاده از دروازهها بهطور مؤثر اطلاعات را در طول زمانهای طولانی حفظ میکند. این شبکه بهویژه برای پردازش زبان طبیعی، پیشبینی سریهای زمانی و تشخیص گفتار کاربرد دارد و مشکلاتی مانند محو شدن گرادیان را حل میکند.

شبکه عصبی حافظه طولانی کوتاه مدت (LSTM) یکی از نوآوریهای برجسته در حوزه یادگیری عمیق و پردازش دادههای دنبالهای است. با توجه به پیشرفتهای سریع در فناوریهای داده و نیاز به تحلیل الگوهای پیچیده در اطلاعات متوالی، LSTM بهعنوان یک راهکار مؤثر برای حل مشکلات متداولی نظیر محو شدن گرادیان در شبکههای عصبی بازگشتی (RNN) معرفی شده است. این شبکهها بهویژه برای پردازش زبان طبیعی، شناسایی گفتار، پیشبینی سریهای زمانی و سایر کاربردهای مرتبط با دادههای ترتیبی طراحی شدهاند.

LSTM با استفاده از ساختار دروازهای منحصر به فرد خود، قادر به ذخیرهسازی و بازیابی اطلاعات در طول زمانهای طولانی است، که این ویژگی به آن اجازه میدهد تا بهطور مؤثری با دادههای پیچیده و غیرخطی کار کند. در این مقاله، به بررسی اصول عملکرد، ساختار و کاربردهای شبکه عصبی LSTM خواهیم پرداخت و تأثیر آن را بر روی پیشرفتهای اخیر در زمینه یادگیری ماشین و هوش مصنوعی تحلیل خواهیم کرد.

پیشنهاد مطالعه: الگوریتم یادگیری تقویتی چیست؟

Table of contents [Show]

چرا LSTM؟

شبکههای عصبی بازگشتی (RNN) برای پردازش دنبالهای از دادهها طراحی شدهاند و معمولاً برای پردازش متن، صدا و سریهای زمانی به کار میروند. مشکل اصلی RNNهای سنتی این است که ناتوان در یادگیری وابستگیهای بلندمدت هستند. یعنی در صورتی که یک دنباله داده بسیار طولانی باشد، اطلاعات مربوط به بخشهای اولیه دنباله ممکن است به راحتی فراموش شود. به این مشکل Vanishing Gradient Problem (مشکل گرادیان ناپدید شونده) گفته میشود.در اینجا، LSTM وارد عمل میشود. LSTM قادر است اطلاعات را برای مدت طولانی حفظ کند و مشکلات یادگیری وابستگیهای طولانیمدت را حل کند.

ساختار شبکه عصبی حافظه طولانی کوتاه مدت (LSTM)

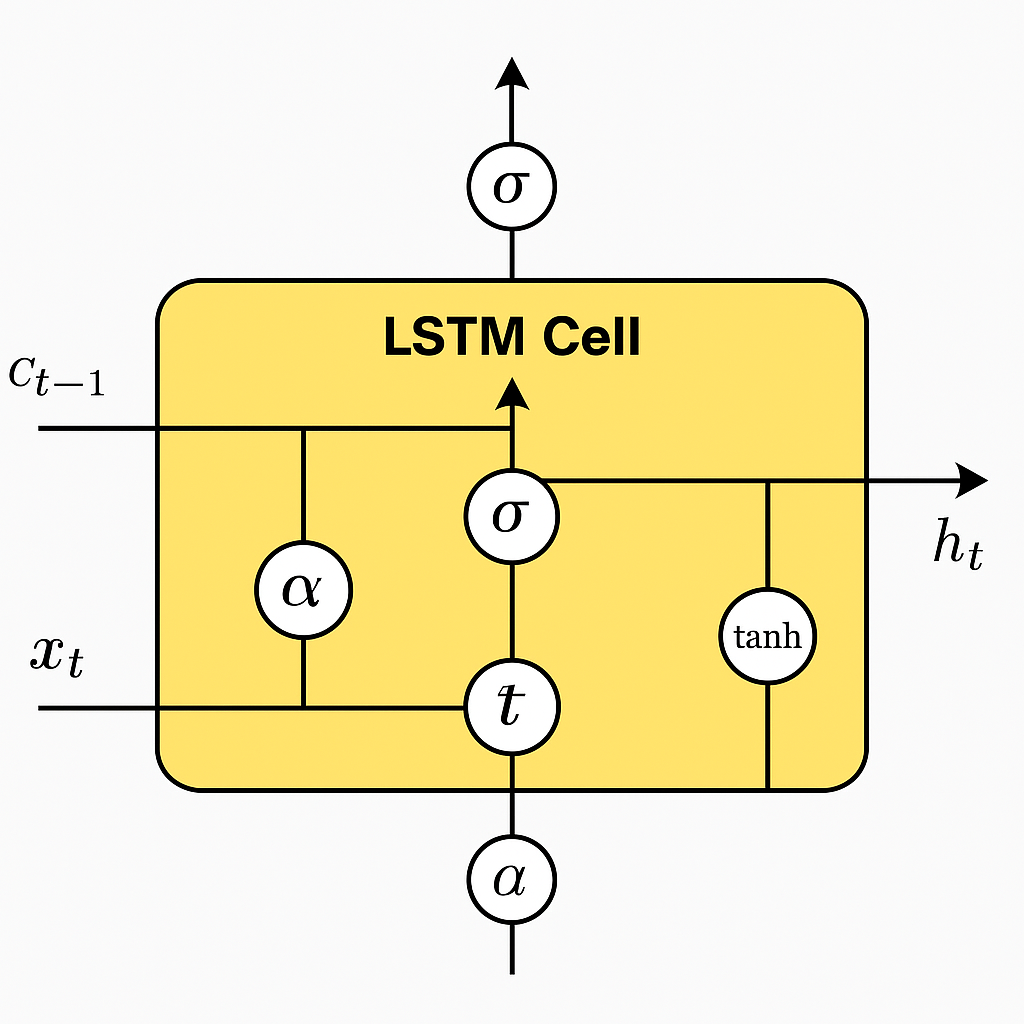

شبکههای LSTM بهعنوان یک نوع خاص از شبکههای عصبی بازگشتی (RNN) طراحی شدهاند تا قابلیت یادآوری اطلاعات در طول زمانهای طولانی را داشته باشند. ساختار LSTM شامل چندین مؤلفه کلیدی است که به آن اجازه میدهد تا بهطور مؤثر با دادههای دنبالهای کار کند. در زیر به اجزای اصلی ساختار LSTM اشاره میشود:

واحدهای حافظه (Cell State)

واحد حافظه یا Cell State هسته اصلی LSTM است که اطلاعات را در طول زمان حفظ میکند. این واحد بهطور مداوم اطلاعات را از طریق دروازهها تغییر میدهد و بهنوعی حافظه طولانیمدت شبکه محسوب میشود.

دروازهها

LSTM شامل سه دروازه اصلی است که مسئول کنترل جریان اطلاعات هستند:

- دروازه ورودی (Input Gate): این دروازه تصمیم میگیرد که کدام اطلاعات جدید به واحد حافظه اضافه شود. از یک تابع سیگموید برای تعیین مقادیر ورودی استفاده میکند و مقادیر جدید را با یک تابع تانژانت هایپر بولیک (tanh) تولید میکند.

- دروازه فراموشی (Forget Gate): این دروازه مشخص میکند که کدام اطلاعات از واحد حافظه حذف شود. با استفاده از تابع سیگموید، این دروازه به شبکه اجازه میدهد تا اطلاعات غیر ضروری را فراموش کند.

- دروازه خروجی (Output Gate): این دروازه تعیین میکند که کدام اطلاعات از واحد حافظه به خروجی ارسال شود. پس از اعمال تابع سیگموید، خروجی نهایی با استفاده از تابع tanh تولید میشود.

فرآیند انتقال اطلاعات

در هر مرحله زمانی، LSTM اطلاعات را از ورودی و وضعیت قبلی دریافت میکند. دروازهها بهطور همزمان عمل میکنند تا اطلاعات جدید را به واحد حافظه اضافه کرده و اطلاعات قدیمی را فراموش کنند. این فرآیند به LSTM این امکان را میدهد که از اطلاعات گذشته بهرهبرداری کرده و تصمیمات بهتری برای پیشبینی آینده اتخاذ کند.

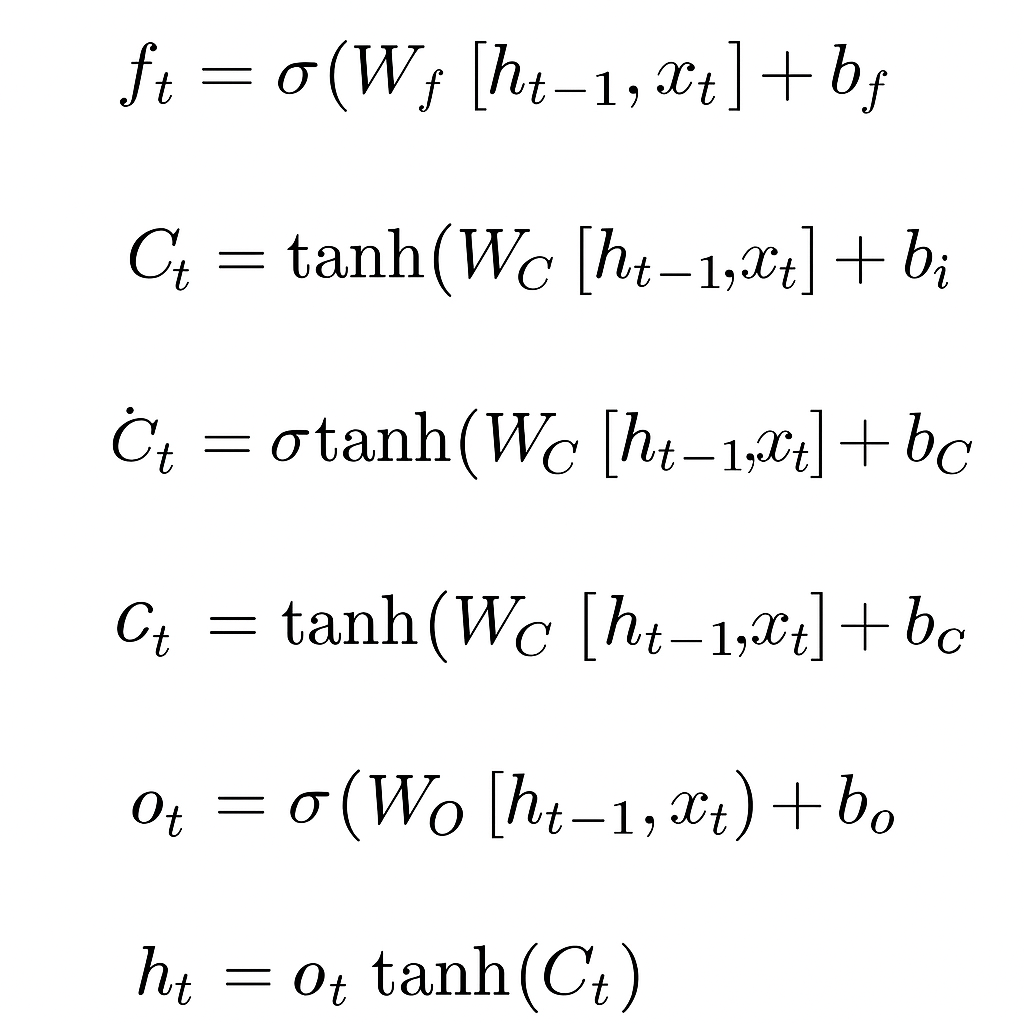

فرمولها در شبکه عصبی حافظه طولانی کوتاه مدت

LSTM شامل چندین معادله است که به کمک آنها عملیات مربوط به هر دروازه محاسبه میشود:

- دروازه فراموشی:

- دروازه ورودی:

- بهروزرسانی حافظه:

- دروازه خروجی:

کاربرد شبکه عصبی حافظه طولانی کوتاه مدت

پیشبینی سریهای زمانی

یکی از کاربردهای اصلی LSTM در پیشبینی سریهای زمانی است، مانند پیشبینی قیمت سهام، پیشبینی آب و هوا، و تحلیل ترافیک وب.

- مثال: فرض کنید که میخواهید قیمت سهام یک شرکت را در روزهای آینده پیشبینی کنید. LSTM میتواند از دادههای گذشته (مثل قیمتهای سهام گذشته) استفاده کند تا روند تغییرات قیمت را یاد بگیرد و پیشبینیهایی برای روزهای آینده ارائه دهد.

پردازش زبان طبیعی (NLP)

LSTM در پردازش زبان طبیعی به طور گستردهای استفاده میشود. به عنوان مثال، در ترجمه ماشینی یا تحلیل احساسات از دادههای متنی.

- مثال: اگر میخواهید یک مدل برای تحلیل احساسات یک متن طراحی کنید (مثلاً تشخیص مثبت یا منفی بودن یک نظر)، LSTM میتواند از دادههای متنی گذشته (کلمات و جملات قبلی) استفاده کرده و پیشبینی کند که احساس نظر چیست.

تشخیص گفتار

LSTM همچنین در تشخیص گفتار و تبدیل گفتار به متن کاربرد دارد. این الگوریتم میتواند از ویژگیهای صدای ورودی استفاده کند تا جملات گفتاری را به متن تبدیل کند.

- مثال: در یک سیستم تشخیص گفتار، LSTM میتواند ورودیهای صوتی را دریافت کرده و کلمات را بهطور پیوسته بهطور صحیح شناسایی کند.

جمعبندی

LSTM یک نوع شبکه عصبی است که برای پردازش دادههای دنبالهای طراحی شده و بهویژه برای مشکلاتی که نیاز به یادگیری وابستگیهای بلندمدت دارند بسیار مؤثر است. با استفاده از دروازهها، LSTM میتواند اطلاعات را به طور مؤثر در طول زمان ذخیره و بازیابی کند و به همین دلیل در بسیاری از مسائل مانند پردازش زبان طبیعی، پیشبینی سریهای زمانی، و تشخیص گفتار کاربرد دارد.

مریم گوهرزاد

مدرس و بنیانگذار هلدینگ آرتا رسانه. برنامه نویس و محقق حوزه بلاکچین